શું તમે નકલી વિડીયો ને ઓળખી શકો છો? ડીપફેકને ફેક ન્યુઝ નું નવું વર્જન કહેવામાં આવી રહ્યું છે. તેનાથી તમે ઓળખી નથી શકતા કે ફેક વિડીયો કયો છે. “ડીપફેક” વીડિયોને ઓળખવું બહુ મુશ્કિલ કામ હોય છે.

આજ કલ ઇન્ટરનેટ પર મિમ્સનો ટ્રેન્ડ ચાલી રહ્યો છે. કોમિક ઈફેક્ટ આપવા માટે ઘણીય વાર ફોટોશોપ કરેલી ઇમેજ નો ઉપયોગ કરવામાં આવે છે. હવે ઈમેજમાં બદલાવનો એક નાયો ટ્રેન્ડ જોવા મળી રહ્યો છે.

આર્ટિફિશિયલ ઇન્ટેલિજન્સ ટેક્નોલોજીની મદદથી ફેક વીડિયોને અસલી વીડિયોમાં તબદીલ કરવામાં આવી રહ્યા છે. આ પ્રકારના “ડીપફેક” વીડિયોને ઓળખવા ખુબ જ મુશ્કિલ હોય છે.

આ પ્રકારના વિડીયો કોઈ પણ વ્યક્તિની છબી ને ભારે નુકશાન પહોંચાડી શકે છે. ડેપફેક શબ્દ પહેલી વાર ૨૦૧૭ માં ચલણમાં આવ્યો. આ ટેક્નોલોજી, વિડીયો અને ઇમેજ ને બદલી શકે છે, વહેંચી શકે છે અને ફેરવી પણ શકે છે.

જેના લીધે અસલી વીડિયોને ઓળખવો મુશ્કિલ બની જાય છે અને નકલી વિડીયો અસલી વિડીયો જેવો જ દેખાતો હોય છે.

ઘણા બધા જોખમ ઉભા કરે છે!

સમગ્ર દુનિયામાં એઆઈ ટેક્નોલોજી સસ્તી થઇ રહી છે અને વધુ થી વધુ લોકો તેને અપનાવી રહ્યા છે અને તેનો ઉપયોગ કરી રહ્યા છે.

ડીપફેકને ઓળખવું ખુબ જ મુશ્કેલી ભર્યું કામ હોય છે. તેને સોશલ મીડિયા પ્લેટફોર્મ જેવા કે યુટ્યુબ, ફેસબુક અને ટ્વિટર ની મદદથી સમગ્ર વિશ્વમાં ફેલાવી શકાય છે.

એક શોધ પ્રમાણે જાણવા મળ્યું છે કે આજની યુવા પેઢી ન્યુઝ જાણવા માટે પણ સોશલ મીડિયા નો ઉપયોગ કરતી હોય છે. પરંતુ, સોશલ મીડિયા કંપની ડીપફેકને રોકવા માટે પ્રયત્ન નથી કરી રહી.

આવનારા સમયમાં ડીપફેક નો ઉપયોગ વધી શકે છે. તેનાથી ઘણા પ્રકારના જોખમ ઉભા થઇ શકે છે અને સૂચનાઓની ગંભીરતા ખતમ થઇ શકે છે. ડીપફેક થી દિલ કરવા માટે સામુહિક પ્રયાસ જરૂરી છે.

મહિલાઓના સન્માનને ઠેસ

મહિલાઓના સન્માનને દીપફેકની મદદથી ઘણું નુકશાન પહોંચાડવામાં આવી રહ્યું છે.

ચાલાક લોકો મહિલાઓના ચહેરાનો ઉપયોગ ખરાબ વીડિયોમાં કરતા હોય છે અને પછી તેમને હેરાન કરતા હોય છે. સોશલ મીડિયા કંપનીઓએ ડીપફેક પર રોક લગાવવા માટે કડક પગલાં લેવાની જરૂર છે.

હવે – ભાવ થી પકડી શકાય છે!

કેટલાક લોકો અને સંસ્થો ભેગા મળીને ડીપફેકને રોકવા માટે એલ્ગોરિધ્મ વિકસિત કરવાની યોજના બનાવી રહ્યા છે.

તમે કોઈ પણ વીડિયોને સાવધાનીપૂર્વક જોઈને ડીપફેકને પકડી શકો છો. વીડિયોમાં ચેહરાના હવે – ભાવ થી ડીપફેક ની ઓળખ થઇ શકે છે.

કોઈ પણ ભરોસો કરવો મુશ્કેલ છે!

કેટલાક દિવસો પહેલા અમેરિકાના પૂર્વ રાષ્ટ્રપતિ બારાક ઓબામા અમેરિકાના હાલ ના રાષ્ટ્રપતિ ડોનાલ્ડ ટ્રમ્પને અપશબ્દો બોલી રહ્યા હતા.

પરંતુ આ વીડિયોમાં બોલવાવાળું વ્યક્તિ ઓબામા નથી. તેમના ચહેરાને ખુબ જ સફાઈ સાથે બદલી દેવામાં આવ્યો છે.

એટલા માટે હવે ઇન્ટરનેટની સુવિધાનો એ સમયગાળો છે જેમાં કઈ પણ વસ્તુ પર વિશ્વાસ કરવો ખુબ જ અઘરું છે.

હાઈ પ્રોફાઈલ લોકો છે નિશાના પર !

હાઈ પ્રોફાઈલ લોકો જેમ કે રાજનેતા અને સેલિબ્રિટીઝની હજારો ફોટોઝ અને વિડિયોઝ ઇન્ટરનેટ પર મોજુદ છે. તે દીપફેકનો સૌથી સહેલો ટાર્ગેટ હોય છે.

ખુબ જ વધારે પ્રમાણમાં ડેટા હોવાને કારણે ડેટાની સરળતાથી એક્સચેન્જ કરી શકાય છે.

સામાન્ય રીતે, તેને કોમેડી માટે ઉપયોગમાં લઇ શકાય છે પરંતુ ભવિષ્યમાં તેમની સુરક્ષા અને લોકતંત્રને જોખમ ઉભું થઇ શકે છે. તેના થી લોકોને ગેરમાર્ગે પણ દોરી શકાય છે.

કન્ટેન્ટ શેરની આદત પર કાબુ કરો!

જો આપણે કોઈ વીડિયોમાં ગડબડ લાગી રહી છે તો ઓનલાઇનમાં જગતમાં તેનું બીજું વર્જન શોધવું જોઈએ.

તેના માટે તમે ગુગલ ઇમેજ સર્ચની મદદ લઇ શકો છો. યુટ્યુબ ડેટા વ્યુવર તમને બતાવી શકે છે કે કયો વિડીયો ક્યારે અપલોડ કરવામાં આવ્યો હતો.

તે રિવર્સ ઇમેજ સરચિંગ માટે થંબનેલઃ ઉપલબ્ધ કરાવે છે. ડીપફેક રોકવાની સૌથી સરળ રીત છે કે તમે કન્ટેન્ટ શેર કરવાની તમારી આદત પર કાબુ રાખો.

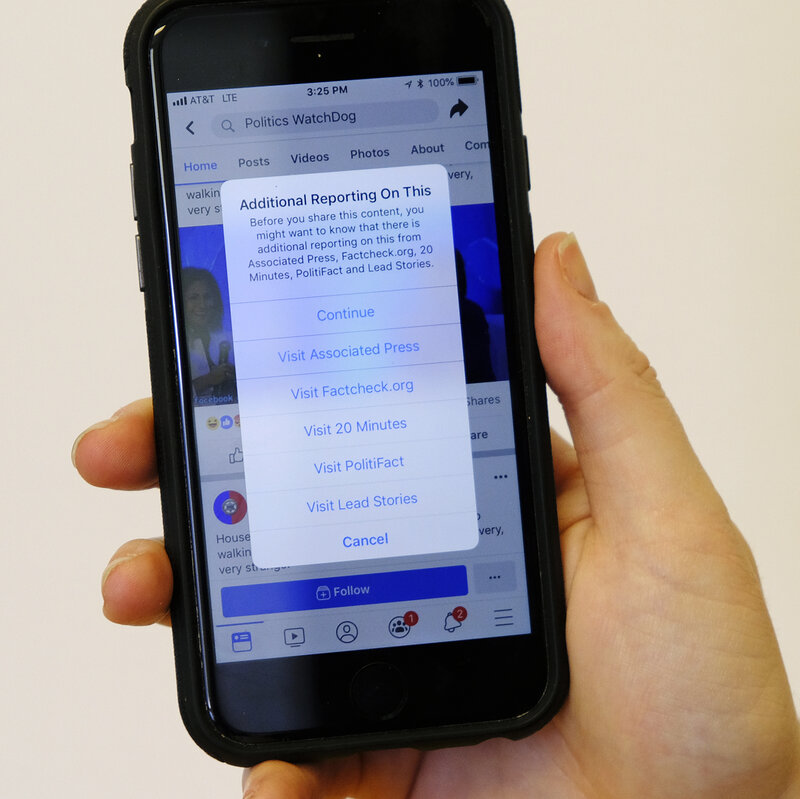

ફેસબુકનો પ્રયાસ!

હાલમાં જ ફેસબુક ના સહ સંસ્થાપક માર્ક ઝુકરબર્ગ એ કહ્યું છે કે વાસ્તવિક લાગવા વળી નકલી વિડીયો ને રોકવા માટે તેનું મૂલ્યાંકન જરૂરી છે. તેના માટે એક નીતિ નો વિકાસ કરવો જરૂરી છે. ઝુકરબર્ગના અનુસાર “ડીપફેક વિડીયો” બિલકુલ અલગ જ કેટેગરીના વિડીયો છે. તેમને ખોટી જાણકારી આપવા વાળા વિડીયો થી અલગ રાખવા જોઈએ.

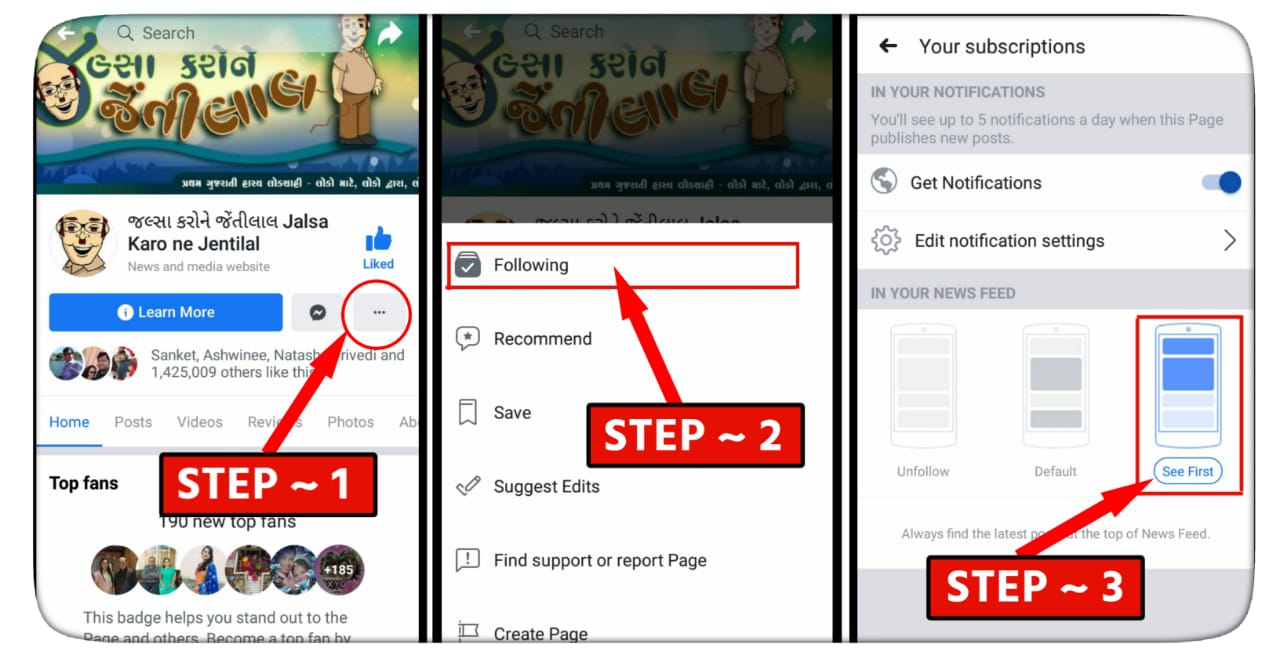

અમારી દરેક પોસ્ટ સૌથી પહેલા વાંચવા નીચેની પ્રોસેસ ફક્ત એકજ વાર કરવાની રહેશે.

વધુ રસપ્રદ માહિતી અને નવી પોસ્ટ વાંચવા માટે ડાબી તરફ સ્વાઇપ કરો.

આપણી માતૃભાષા 21મી સદીમાં પણ જીવંત રહે અને નવી પેઢીને એનો લાભ મળે એ માટે અમે રોજ નવી સ્ટોરી, રસપ્રદ લેખો, ઉપયોગી માહિતી, લાઈફ ઇઝી ટિપ્સ, નવી નવી વાનગીઓની વણઝાર તમારા ફેસબુકમાં લાવવા કટિબદ્ધ છીએ !

– તમારો જેંતીલાલ